AI

בינה מלאכותית: הסוכן העל החדש שלך או הרודן המושלם

כאשר טכנולוגיה מגבילה או מרחיבה חירות – ומה המשמעות של זה עבור כולנו

חלפו שנתיים מאז ש-MSG Entertainment – מפעילת מקומות כמו מדיסון סקוור גארדן האגדי – עוררה כותרות בזכות בינה מלאכותית. מערכת מתוחכמת לזיהוי פנים הופעלה כדי למנוע כניסת עורכי דין המייצגים משרדים המתדיינים משפטית נגד החברה. התוצאה? עורכי דין לא הורשו להשתתף במופעים או אירועי ספורט, מה שהוביל במהירות לעימות משפטי אזרחי. עורכי הדין תבעו – כמובן. ובזמן שכמה צופים חייכו למשמע הסיפור, מנכ"ל אחד העיר בשלוות נפש: "מצוין.

אולם מה שבמבט ראשון נראה כמו עניין פעוט, פותח את הדלת לאחד הדיונים המרכזיים של זמננו: איך משפיעה הבינה המלאכותית על המאזן העדין בין חירות אישית, התקדמות חברתית ואינטרסים כלכליים? והאם אנחנו עדיין השחקנים הראשיים בהתפתחות זו – או כבר מזמן רק ניצבים?

החירות שלא להיות חופשי

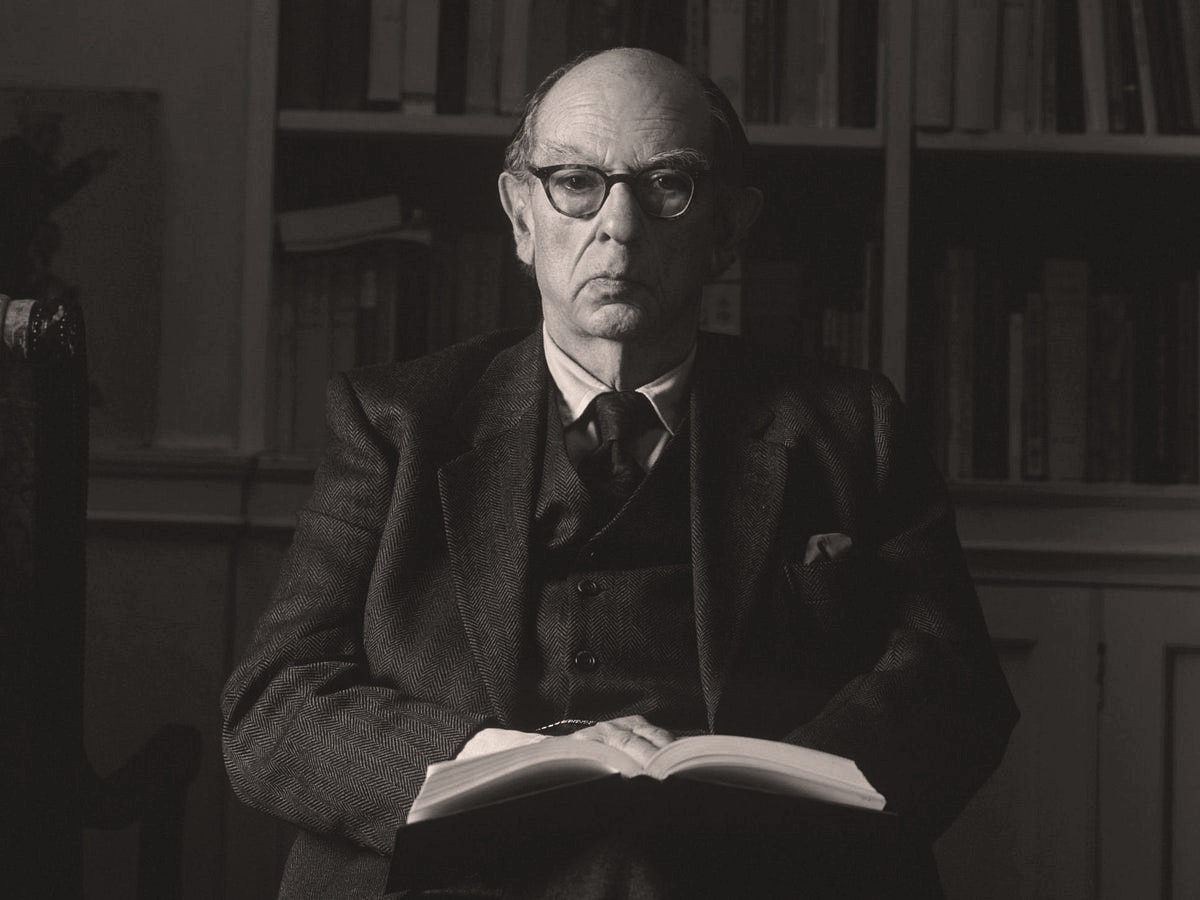

ריד הופמן, משקיע טכנולוגי ומייסד שותף של לינקדאין, דן לאחרונה בשאלות אלו בנאום בלונדון. הוא התייחס למושגים המפורסמים של הפילוסוף ישעיה ברלין: "חירות שלילית" (החירות מכפייה חיצונית) ו"חירות חיובית" (היכולת לפעול לפי רצון עצמי). שניים אלו, לדברי ברלין, נמצאים לעיתים קרובות בקונפליקט. דמוקרטיות מנסות למצוא דרך באמצעות פשרה – בהצלחה משתנה.

הופמן מזהיר: בעוד שהטכנולוגיות הישנות יותר היו בעיקר כלים, הבינה המלאכותית היא משהו חדש ביסודו. היא מחליטה, יוצרת ומעריכה באופן עצמאי – ויכולה בכך גם להעניק לנו חירות וגם לשלול אותה מאיתנו. בספרו "נקסוס" מכנה יובל נח הררי את הבינה המלאכותית אפילו כ"אינטליגנציה חוצנית", שבשונה מפצצת האטום, יכולה לפעול באופן עצמאי. הררי מצייר תרחישים קודרים: רחפנים שמחליטים בעצמם את מי לתקוף. אלגוריתמים המנציחים אי-צדק חברתי. עולם כלוב בלתי נראה.

דוֹך הופמן טוען אחרת. לפי התזה שלו, בינה מלאכותית אינה יכולה להיות רק תרחיש איום. היא יכולה גם להפוך ל"סוכנת העל" האולטימטיבית של האדם – אם נשתמש בה נכון.

כוחות על לחיי היומיום

דמיינו לעצמכם שאינטליגנציה מלאכותית הייתה העוזרת האישית שלכם: היא עוזרת לכם להבין חוזים מורכבים, מלמדת את ילדיכם מתמטיקה או הופכת אתכם לעובדים מיומנים יותר. עם מערכות כמו ChatGPT, כך הופמן, אנשים יכולים לגלות את "הכוחות העל" האישיים שלהם - יצירתיים, חדשניים ועצמאיים.

חירות חיובית זו, כפי שמכנה אותה הופמן, מאפשרת לכל אחד להפיק את המיטב מעצמו בחברה מבוזרת וגמישה. "כלים כמו ChatGPT הם כמו GPS למידע," הוא מסביר. אין כפייה, אלא תמיכה.

Doch dieser optimistische Blick übersieht eine entscheidende Frage: מי מחליט כיצד יפותחו טכנולוגיות אלו? ואיך נמנע מהפיכת החופש לשליטה?

סין: הצד האפל של ה"סופר-סוכנות

מי שרוצה לראות איך לא צריך לנהל עניינים, מביט על סין. שם משתמשת הממשלה בבינה מלאכותית כדי לפקח על האזרחים ולבצר משטר סמכותני. זיהוי פנים וביג דאטה יוצרים עולם אשר מומחים מכנים "כלוב בלתי נראה". מה שחופש חיובי עבור הופמן, הופך כאן לקליפה רטורית: התועלת הקולקטיבית משרתת רק אליטה קטנה.

דו"ח של קרן המידע והחדשנות מזהיר כי סין עשויה בקרוב לעקוף את ארה"ב בפיתוח הבינה המלאכותית – אם הדבר לא קרה כבר. מה אז? כיצד מגינות חברות דמוקרטיות על ערכיהן כאשר משטרים אוטוריטריים מנצלים את הבינה המלאכותית לדיכוי חופש?

מלחמה בלתי נראית

:דיון ה-AI הוא יותר מפילוסופיה טכנולוגית. הוא מאבק על ערכים וכוח. השאלה היא לא אם ה-AI יקבע את עתידנו, אלא איך. האם נישאר היוצרים, או רק הצופים?

בעוד דמוקרטיות מתמודדות בקושי עם פשרות, סין מוכיחה עד כמה ניתן לנצל לרעה את הבינה המלאכותית. אך האופטימיות של הופמן מראה: יש חלופה. אם נשתמש בבינה מלאכותית כדי להעצים אנשים ובמקביל נציב כללים ברורים, היא יכולה להפוך ל"סוכנת על" – כלי שמקדם את חירותנו האישית ובו זמנית מחבר בינינו.

בסופו של דבר, הבינה המלאכותית אינה ידיד ולא אויב. היא מראה של החלטותינו. והשאלה נותרת: מה נראה?